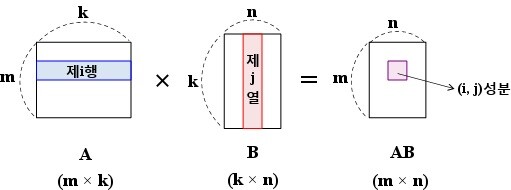

고등학교 수학에서 처음 배우게 되는

행렬의 곱셈은 "이딴거 배워서 어따 쓰냐?"

뭐 근데 요즘 고딩때 행렬 안배운다고?

라떼는 말이야...

라는 생각과 다르게 현대 컴퓨팅에서 가장 중요한 부분임

스마트폰의 이미지 처리

음성 인식, 게임 그래픽 연산

날씨 예측 시뮬레이션, 이미지 / 동영상 압축 등

행렬 계산이 컴퓨팅에서 안필요한 부분이 없음

그리고 현대 행렬 곱셈 계산 알고리즘은

1969년 독일의 수학자 폴커 슈트라센이 개발한

슈트라센 알고리즘과 그 변형을 기반으로 함

알파고에서 시작한 구글의 AI는

현재 알파텐서라고 부르는데

알파텐서는 기존의 행렬계산 알고리즘보다 더 빠른 알고리즘을 학습해왔고

얼마 전 그 결과가 나옴.

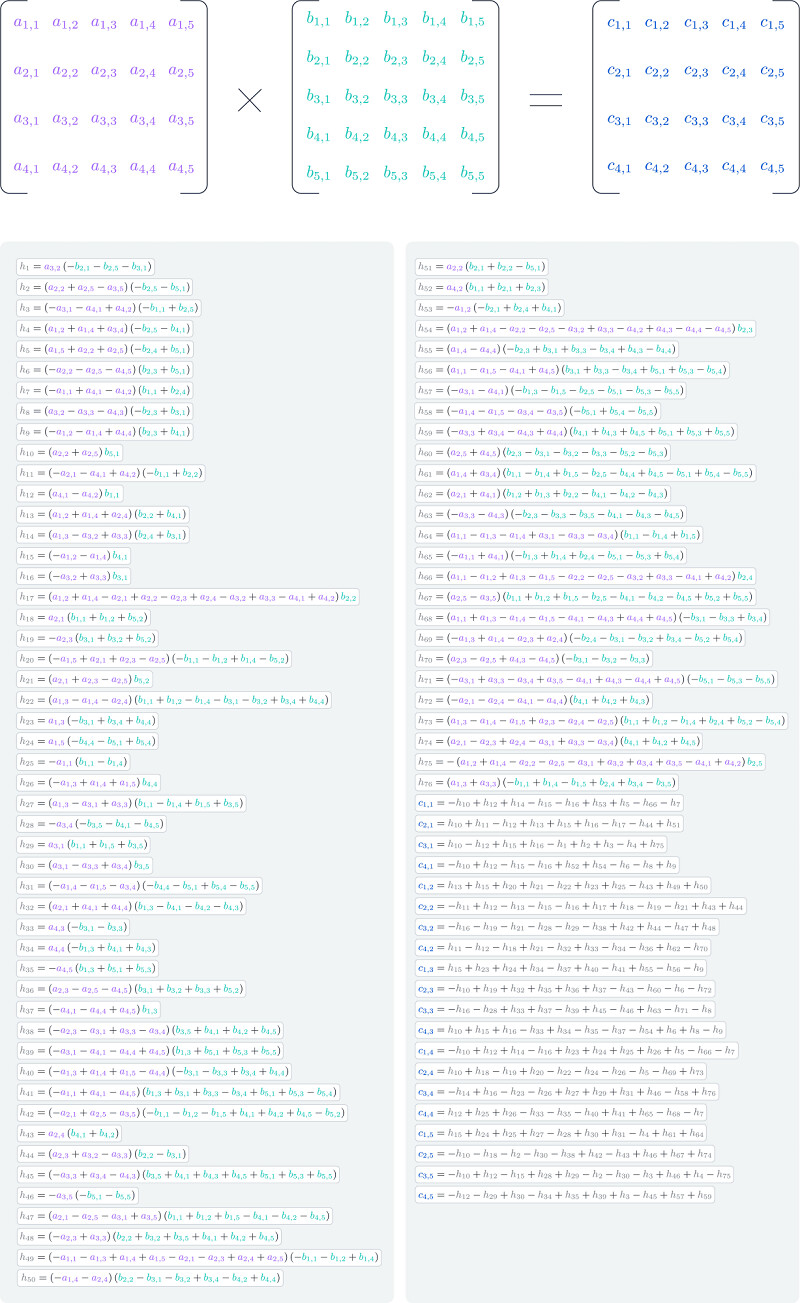

(4*5) * (5*5) 행렬의 곱셈을 계산할 때

단순하게 계산하면 100번의 과정을 거쳐야 하고

인간이 수십년간 연구한 알고리즘을 사용하면 80번의 계산과정을 거치는데

구글의 알파텐서는 76번으로 계산과정을 줄임

학습과정에서 알파텐서에게 슈트라센 알고리즘을 따로 가르키지 않았으나

스스로 학습하는 과정에서 슈트라센 알고리즘과 유사한 방법을 사용했으며

이윽고 거기서 한단계 더 나아가 계산과정을 더 줄임

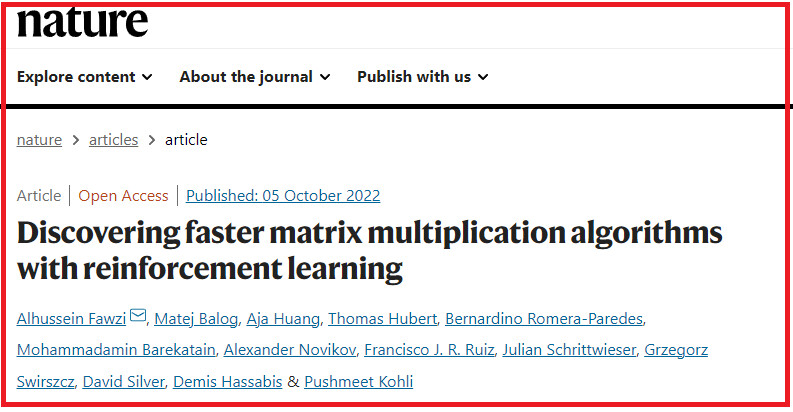

구글 딥마인드는 이 방법을 논문으로 제출해

네이처에도 실린 이 알고리즘을 이용하면

기존 행렬곱셈을 사용한 연산속도를 10~20% 까지 올릴 수 있다고 함

4번 줄인게 얼마나 큰가 했는데 마른행주 짜고있는 시점에서 5%면 큰거 맞네

20%면 압도적인 성능개선이군

특히 장비를 바꾸지 않고 계산방법만 바꾸는걸로 그냥 성능이 10~20% 상승함 업계에선 그냥 쌍수들고 덩실덩실 박수치고 난리나는거임

개인용 PC에서는 거의 상관없는 이야기고 AI 연구할 때 쓰는 엔비디아 전용 칩 그런거

아조씨 7차교육과정(17학번)부터 고딩때 행렬 안배워요

마른행주라는 비유가 겁나 직관적이네ㅋㅋㅋㅋㅋㅋ

다음교육과정에 다시 행렬 들어감 ㅇㅇ(현중1)

20%면 압도적인 성능개선이군

4번 줄인게 얼마나 큰가 했는데 마른행주 짜고있는 시점에서 5%면 큰거 맞네

시노부

마른행주라는 비유가 겁나 직관적이네ㅋㅋㅋㅋㅋㅋ

소프트웨어의 발달로 cpu 속도를 간접적으로 올릴수도 있단말??

개인용 PC에서는 거의 상관없는 이야기고 AI 연구할 때 쓰는 엔비디아 전용 칩 그런거

그래도 그 세계에서 5% 상승이면 엄청난거겠지

특히 장비를 바꾸지 않고 계산방법만 바꾸는걸로 그냥 성능이 10~20% 상승함 업계에선 그냥 쌍수들고 덩실덩실 박수치고 난리나는거임

행렬이 신기하긴 해 참 여러가지 튀어나오고

루리웹-9420530339

... 그러나 결국 그쪽으로 ...

언젠가는 AI의 연산을 인간이 이해할 수 없는 날도 오겠지

아조씨 7차교육과정(17학번)부터 고딩때 행렬 안배워요

07학번도 7차 교육과정인데 라때는 행렬 배웠다 이말이야 뭐 근데 왜 지금은 안배우냐

루리웹-0495765362

다음교육과정에 다시 행렬 들어감 ㅇㅇ(현중1)

오 그건 몰랐는데. 지금 내가 고2인데 고3,고1 다 달라서 혼란스러움

나도 이생각했는데 댓글에있네ㅋㅋ 대학가서 처음봄 행렬

행렬이 웬만한 수식은 다 처리 가능하던데... 대학서 행렬 배울 때 고딩때 쓸때없이 외우던 공식 버리게 만드니까 허탈하던데...

아규멘티드 행렬 갖고 디터미넌트 계산하는거 개화남

알파고님 지구를 유토피아로 만들어주세요

와 슈트라센 알고리즘에서 그걸 다 줄였다고??? 제어공학계의 혁명감인데?

제가 지금 고딩인데요. 현 교육과정에서는 행렬 안배워요.

대학가면 배워요 선형대수학

2016년 수능친 내가 마지막이었던 걸로 기억한다 근데 난 재수해서 행렬 없는 교육과정도 겪어봄

그건 대학이지 본문처럼 고등학교때 안배우잖아

아 본문에 고딩때 처음 배우는이라고 있었구나

근데 다음 교육때 또 들어간다네 참ㅋㅋㅋㅋ

빼면 안될 내용이라 그런듯...

디지털, 인공지능 교육을 강화한다면서 거기에 필요한 수학적 지식을 빼먹는건 앞뒤가 안맞는 내용이니까.. 그마저도 안 넣을려고 발악하던거 욕 드릅게 처먹고 들어가나보네

행렬 안배우고 대학 갔다가 고생해서 그런듯

저런거 활용하는 레벨에서는 연산 단위가 몇 만 x 몇 만 이상으로 어마어마해서 연산시간도 어마무시할텐데, 거기서 저정도 절약된다면.... ㄷㄷㄷㄷ 10년 걸릴거 9년 걸린다거나 ㄷㄷㄷ

이제 인간이 ai한테 배울날도 얼마 안남은건가 ㄷㄷ

얼마 안남은게 아니라 이번 연구로 기계한테 행렬 배움

바둑도 AI 가 둔거 가지고 배우던데요

AI스스로 개선하고 진화하고 또 개선하고 진화하고 점점 더 진화가 빨라지고... 그게 바로 AI에게 기대하는 부분이기도 하고 한편 우려하는 부분이기도 하고

... 헐 ... 언제쩍 얘기를 ...

학자들이 먼저 대체되는건가?!

3D 그래픽도 성능향상이 가능하다

연비 20퍼 상승

고등학교때 행렬 안배웠는데?

신경망이라는게 행렬곱의 나열이고 그 안에서 가중치를 조절해나가는 것이기 때문에 최소한 AI의 연산에 있어서는 대단한 발견임

지금 논란되는 AI그림 모델들의 내부에서는 convolution이라는 계산을 하는데, 가장 빠르다고 알려진convolution 알고리즘이 위노그라드 계산법이고, 위노그라드는 슈트라센의 개선버전 중 하나임. 저런 계산 알고리즘이 빨라지면 AI연산도 빨라지니까.....당장 적용되었을 때 직접적인 혜택을 볼 수 있는 사용자도 꽤나 있지 않을까

저게 일반화까지된건가?

나중에 알파고로 CPU 나 GPU 만드는 날도 오려나? ㄷ

기계가 설계한 기계인가, 이것이 스카이넷

좀만 학습 시키면 진짜로 하나의 칩이 모든 역할을 다 하는 진정한 의미의 SoC도 설계할 수 있을 듯.

이미 칩 설계에 AI가 부분적으로 개입함 작년인가 발표보면 전문가가 설계한거보다 높은 성능, 전력 효율, 적은 개발시간 단축등을 달성했지만 레이아웃이 좀 실제 생산하기에는 불리하든가 그랬던걸로

이미 구글 딥마인드는 같은 부품을 박아도 인간이 설계한 것보다 더 뛰어난 칩 설계를 발표한 적 있음 a. 가 인간이 설계한 시스템 칩이고 정갈해보이는데 b. 가 구글이 설계한 칩이고 더 복잡해보이지만 성능은 b 쪽이 우위임 문제는 인간의 기술로는 아직 b 처럼 칩을 못만듬

... 인간 창의성의 한계 ...

고딩때 아니 수학 행렬, 집합, 미적분 등등 이딴거 왜 배우지 하다가 대학 이공계던 상경이던 숫자 만지작 하는데 가면 알게됨 아 존나 쌩기초 근본 학문이었네.. 그리고 내 머리는 그 기초도 모르는데 응용은 절대 할 수 없단걸 알게 됨 ㅋㅅㅋ

배울땐 이런거 평생 어디 쓸데도 없을거같은데 왜 배우지 햇는데, 안쓰는데가 없었음..ㅋ

와 그게 줄여져?? 그나저나 저런것도 증명이 되나? 00의 최소 연산 횟수는 00이다. 이런?? 여태 증명이 안되서 80에서 멈춰있었던거같은데..

행렬은 보기에 좋고 컴퓨터에 입력하기도 좋은데 내가 직접 계산하면 개노가다야

뭘 어케 한거지?

행렬 계산 줄여서 효과볼 수 있는 분야 중 하나가 무선통신분야지. 지금이야 5G까지는 전부 OFDM 기반이라 FFT로 다해먹지만, 그보다 나은 기술이 많이 논문으로 나왔음에도 연산 복잡도 때문에 실제로는 못써먹는게 태반. 예를 들어, 지금 안테나 고작 두세개 더 늘어나고 MIMO 제대로 지원하는 무선 공유기 가격이 기하급수적으로 올라가고, 안테나 16개 이상부터는 막 100만원 대로 올라가기도 하는데, 여기서 연산량이 10%만이라도 줄잖어? 가격은 20%이상 줄어든다. 안테나 늘어난 만큼 속도도 빨라지는데도 말여.

Fft 다음으로 어떤 알고리듬 싸요?

안테나 측면에선 MIMO 채널 보상행렬, 쉽게 말해서 전파가 아주 많이 반사, 굴절 등등이 일어나는 실내 같은 환경을 반사가 없는 텅빈 우주공간같은 환경으로 역변환 시키는 과정이 대표적입니다. 이 과정이 안테나 수의 제곱에 비례하게 연산량이 늘어나는데, 저가로는 거의 실제로는 쓰지 못할 수준이예요.

그럼 그냥 안테나 1개 쓰먄 안되나요? 연산량만 늘어나면 언테나가 많이 필요한 이유가 또 있겠죠?

유선케이블이 많으면 많을 수록 더 빠른 속도로 보낼 수 있는 것처럼, 안테나 수대로 더 많이 보낼 수 있습니다. 안테나 1개쓸 때보다 4개 쓰면 같은 시간동안 4배의 데이터를 보낼 수 있죠.

그럼 안테나수가 적은 저가형에는 굳이 그 기술을 쓸필요 없고 고스펫 고가형 모델에는 아직 너무 비싸서 안쓴다는거네요 ㄱㅅㄱㅅ

ai가 공부하는게 그대로 새로운 계산 수식 논문이되는 세상이왔네...그래픽스 난리나겟다

특이점오나