사용한 영상은 짧은 영상을 찾다가 콘콘속보를 이용했습니다

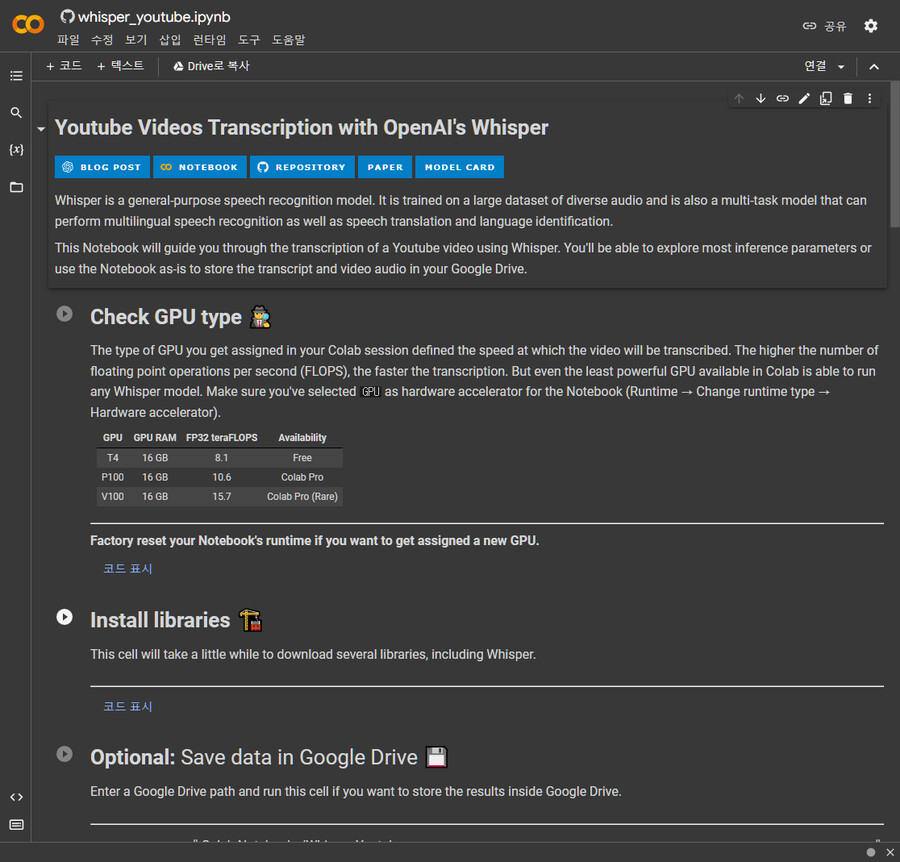

사용한 Colab 파이썬 코드 입니다 https://colab.research.google.com/github/ArthurFDLR/whisper-youtube/blob/main/whisper_youtube.ipynb

만든사람의 Github

https://github.com/ArthurFDLR/whisper-youtube

Colab의 경우 구글에서 컴퓨팅 자원을 제한적으로 무료로 제공해주기 때문에 간단한 용도로 자주 쓰입니다

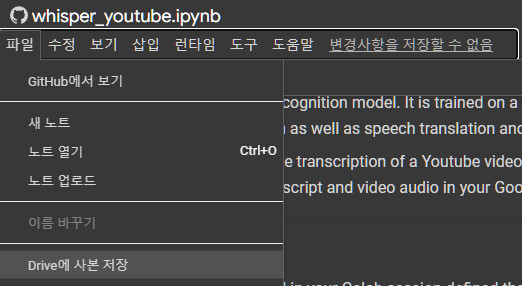

사용 전에 Drive에 사본을 저장해서 사용했습니다.

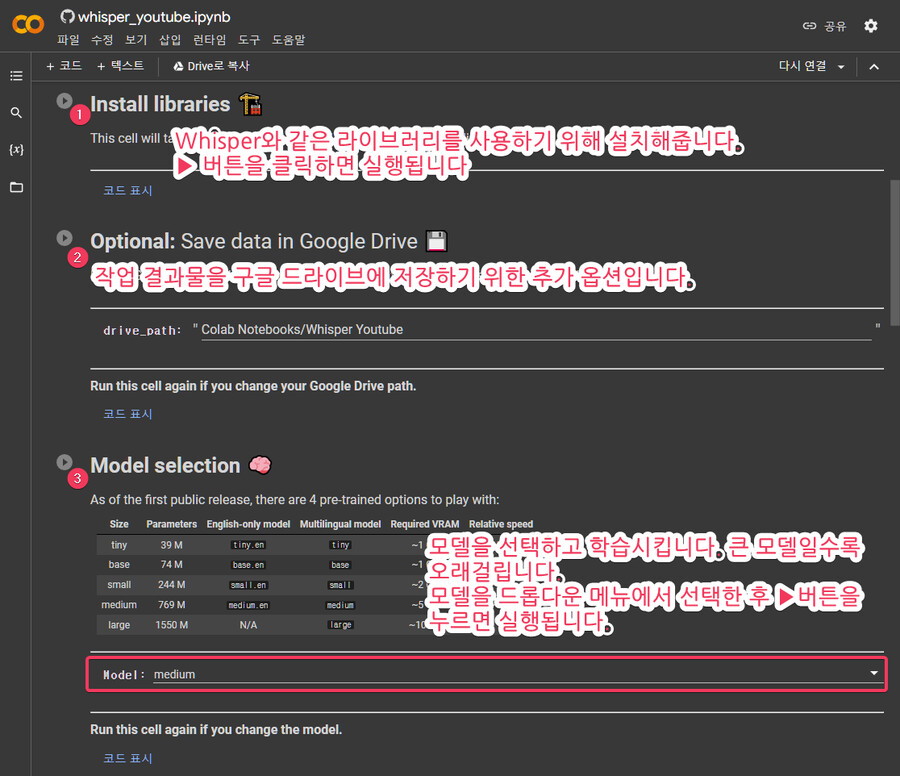

성공적으로 완료되면 ▶옆에 녹색 체크와 걸린 시간이 표시되니 동작이 성공한 걸 확인하고 다음 걸 실행합니다

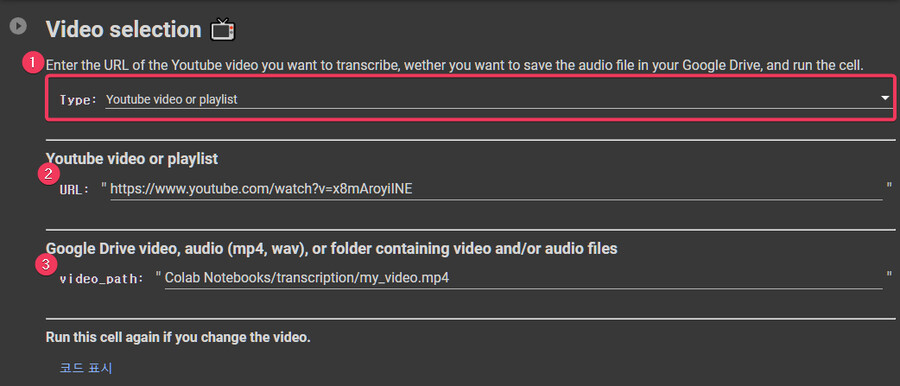

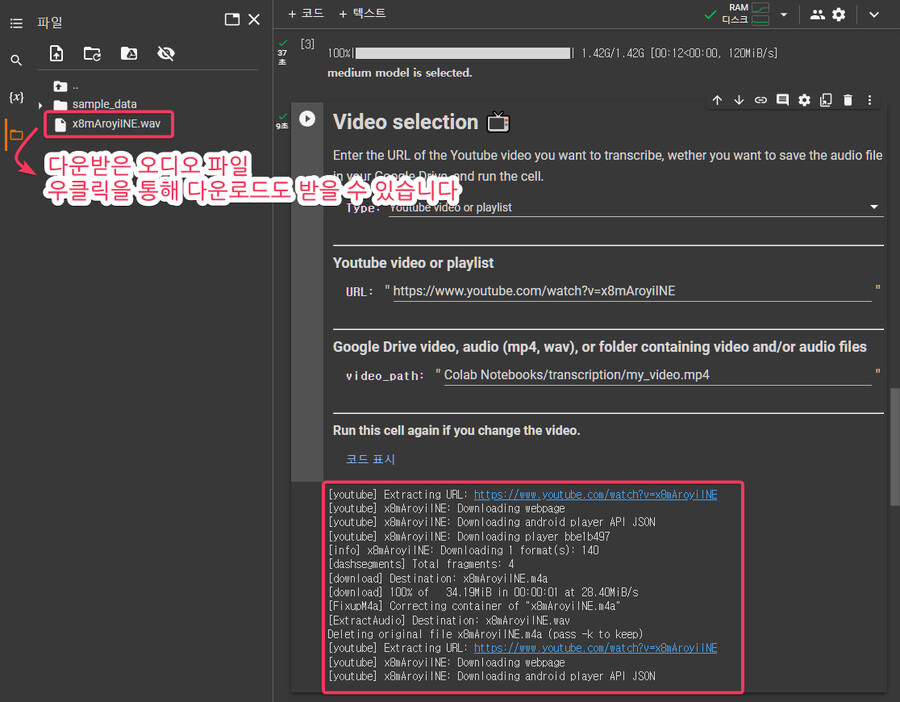

1. 유튜브에서 영상을 yt-dlp를 이용해서 받을 건지 구글 드라이브에 올려놓은 영상이나 오디오를 이용할 건지 선택합니다

2. 유튜브를 선택하면 사용하는 URL 입니다.

3. 구글드라이브를 선택하면 사용하는 내부영상 경로입니다.

유튜브를 선택한 경우 내부에 오디오를 받습니다.

동작후 영상을 바꾸고 싶으면 여기서 영상을 바꾼 후 다시 실행해야 합니다

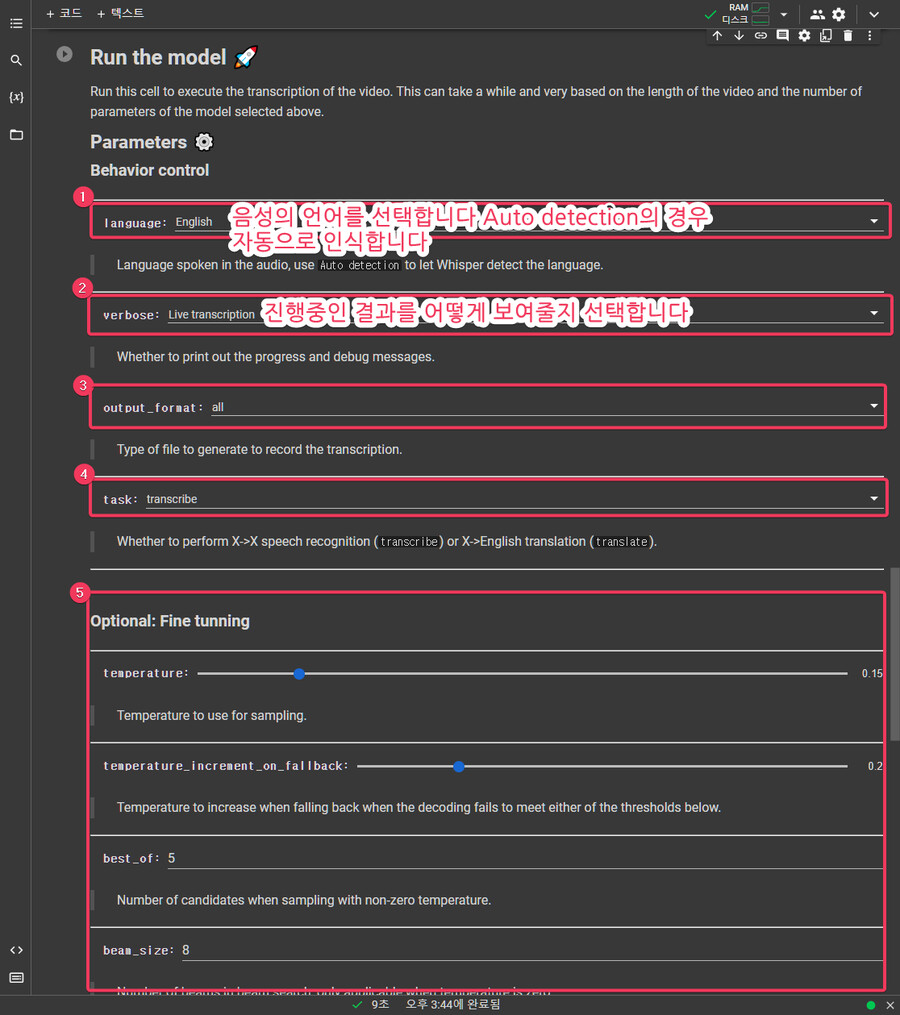

2. Live transaction의 경우 인식된 내용이 실시간으로 출력되서 보여주고 Progress bar의 경우 작업 진행바가 보입니다.

3. 출력할 포맷입니다. All을 선택하면 모두 다 나옵니다.

4.transcribe는 언어 그대로 출력 translate는 영어로 번역해줍니다.

5. 모델을 상세 설정합니다. 이 부분은 경험도 중요하고 어떤 영향을 줄지 예측하기 어려워서 그냥 기본으로 사용했습니다.

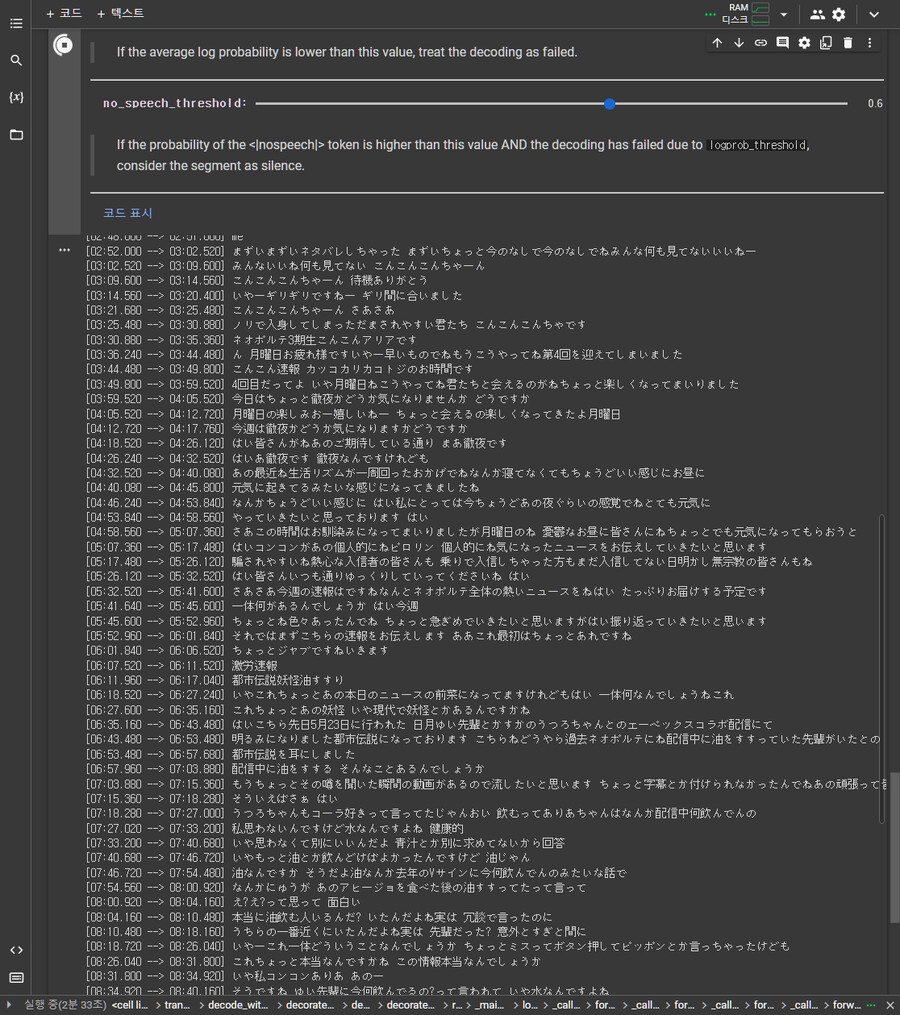

vervose의 값을 live transcription으로 실행한 모습

너무 오래 걸릴 경우 런타임 연결이 끊길 수 있습니다.

완료된 결과는 좌측 파일에서 확인 할 수 있고

srt 파일을 다운로드 받습니다.

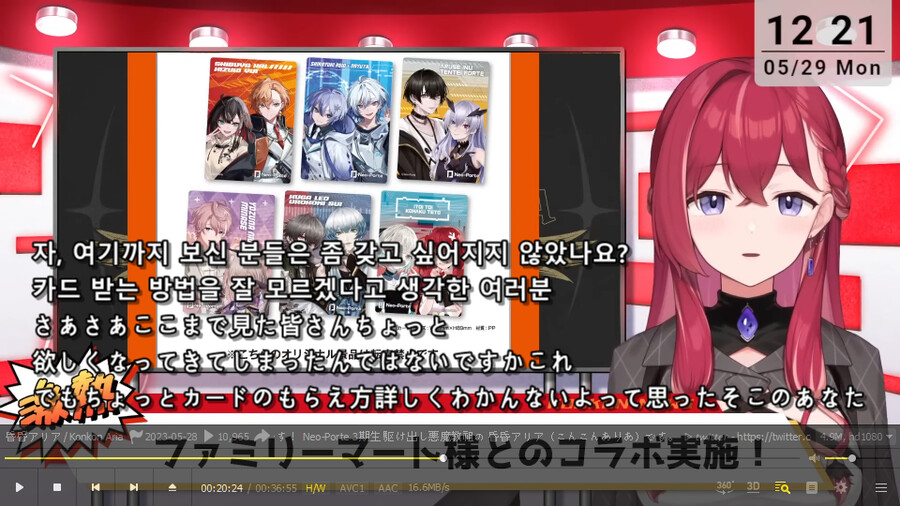

덤+

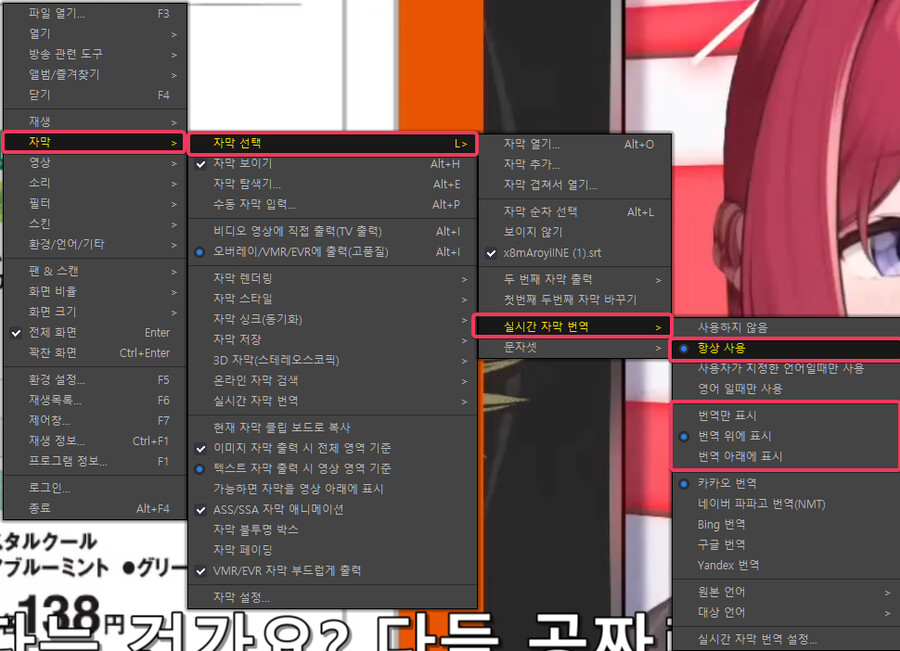

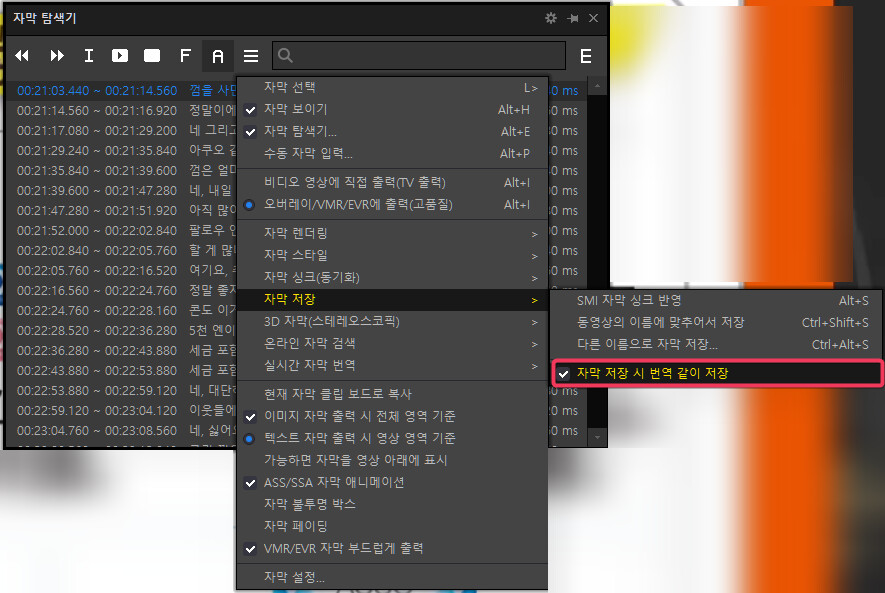

팟플레이어로 유튜브를 실행시키고 그 위에 자막을 열었습니다.

팟플레이어로 연 이유는 자동 자막 번역기능 때문입니다.

이걸 이용하면

현재 기준으로 일부만 번역하기 떄문에 재생을 많이 돌려야 전부 번역되는 불편함이 있긴 한데 저장시 번역 같이 저장을 이용하면 자막도 번역할 수 있습니다.

사실 원래는 DeepL로 자막 자동번역을 추가하려 한건데 API 없이 무료로하려니 처음에는 잘 되다가 블락된건지 타임아웃이 나서 포기

Google 번역은 무료로도 번역이 되긴하는데 기계번역 수준의 번역이라 의미가 없어서

합방같은경우는 영어로 화자구분 기능추가 해보려고 테스트해봤는데 겹치는 부분 대사가 잘 구분안되더라고요 원래 목적은 출력된 자막을 자동번역 기능을 추가하는거였어서 whisper자체는 그렇게 많이 안써봤어

유투브에서 생성하는 자막은 여러명의 대화가 겹치면.. 그 타이밍은 아예 안나오거나 하던데 혹시 합방영상 같은데서는 인식이 잘 되나요? 사실 지금 보여주신것만 해도... 자막 타이밍 잡아주고. 원어/ 해석 보여주니 기존에 직접 받아쓰기하고, 직접 자막 타이밍 잡던때와 비교하면 엄청나게 작업속도가 오를꺼 같긴합니다 딕션 나쁘고 말끝 흐리거나 뭉게는 사람들의 발언까지도 모두 알아듣는 날이 오길 바라며.... (언젠간 히메모리 루나의 발음과 의도를 분석해주는 날이 올지도? ㅋ)

유투브에서 생성하는 자막은 여러명의 대화가 겹치면.. 그 타이밍은 아예 안나오거나 하던데 혹시 합방영상 같은데서는 인식이 잘 되나요? 사실 지금 보여주신것만 해도... 자막 타이밍 잡아주고. 원어/ 해석 보여주니 기존에 직접 받아쓰기하고, 직접 자막 타이밍 잡던때와 비교하면 엄청나게 작업속도가 오를꺼 같긴합니다 딕션 나쁘고 말끝 흐리거나 뭉게는 사람들의 발언까지도 모두 알아듣는 날이 오길 바라며.... (언젠간 히메모리 루나의 발음과 의도를 분석해주는 날이 올지도? ㅋ)

합방같은경우는 영어로 화자구분 기능추가 해보려고 테스트해봤는데 겹치는 부분 대사가 잘 구분안되더라고요 원래 목적은 출력된 자막을 자동번역 기능을 추가하는거였어서 whisper자체는 그렇게 많이 안써봤어