애플이 아동성학대물(CSAM, Child Sexual Abuse Material) 검열 기능 개발을 완전 중단했습니다.

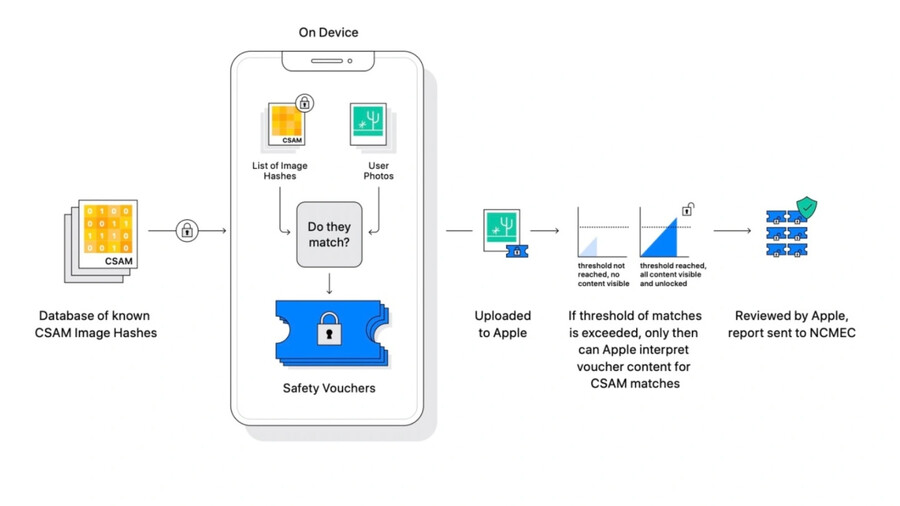

이 기능은 지난 2021년 8월 처음 발표한 기능으로, 사용자들이 iCloud 드라이브에 업로드한 사진들의 해시값을 기존 수사기관에 등록된 데이터와 대조하여 아동성학대물을 차단할 수 있다는 것이 요지였습니다.

그러나 애플이 해당 기능을 도입하겠다고 발표한 이후, 전세계적으로 많은 비판이 제기되었습니다. 정부 당국에서 정치적 반대 세력을 잡아내기 위해 비교에 사용되는 해시값을 악용할 수 있고, 또 같은 알고리즘을 사용했을 때 전혀 다른 사진인데도 대조에 사용하는 해시값이 동일하게 생성될 수 있는 문제 등의 지적이 이어졌습니다. 결국 애플은 한달만에 기능 도입을 무기한 연기하고 더 나은 적용 방법이 있는지 찾아보겠다고 말했었습니다.

그러나 오늘 WSJ와의 인터뷰에서 Craig Federighi는 애플이 이 기능 개발을 중단했다고 밝혔습니다.

[기타] 애플, 아동성학대물(CSAM) 검열 기능 개발 중단

합법 성인물을 아동성착취물과 동일한 해시값을 갖도록 인위적으로 조작하는게 가능한 개판 기술이었죠.

한국에서 저런 검열 비판하면 "소아성애야동에 목숨 걸었냐!!" 욕만 먹는데

성인물 단속은 ㄹㅇ 가장 이용해먹기 좋은 핑계라 무조건 의심하고 막아야함

저래놓고 짱■ 검열용으로 써먹으려고 했었을 것 같다

정작 텔레그램에는 아무런 조치도 못했다는게 유머...

합법 성인물을 아동성착취물과 동일한 해시값을 갖도록 인위적으로 조작하는게 가능한 개판 기술이었죠.

포기하길 잘한거 같네요. 취지는 좋았는데 부작용이 너무 컸습니다

저래놓고 짱■ 검열용으로 써먹으려고 했었을 것 같다

한국에서 저런 검열 비판하면 "소아성애야동에 목숨 걸었냐!!" 욕만 먹는데

루리웹-3815128472

정작 텔레그램에는 아무런 조치도 못했다는게 유머...

우리나란 뭔 비판만 하면 사람 하나 개쓰레기 만듬

이미 욕함 텔레그램 쓰면 이상하게 보고 정치인이 아이폰 쓰면 손가락질 함

검열 까면 야동에 미쳤냐고 까던게 이 사이트의 ‘일부’들이었지....

카톡 터졌을때 대안으로 텔레그램 제시하면 예비범죄자 취급한 미개한 나라인데 뭘

성인물 단속은 ㄹㅇ 가장 이용해먹기 좋은 핑계라 무조건 의심하고 막아야함

그걸 실현화한 ㄱ ㅐ죶선

황금방패같은거지 ㅋㅋ

의도가 아무리 좋아도 악용하기 너무 좋으면 뭐...

저거 내가 알기로 해쉬값이 진짜 조금만 달라져도 바뀌어서 비교가 원본 보는거 아니면 비교가 힘들다고 들었는데

루리웹-6942285846

스크롤하다 실수로 추천 준 김에 대댓글을 남기자면, 나중에 더 발전하면 좋은 기술이 될 여지가 없진 않겠으나 현재로선 아님. 기술적으로 문제가 있다는 것도 접은 이유 중 하나예요.

루리웹-6942285846

대부분 독재 국가에서 정치 검열 시작할때 바로 정치 이슈로 시작하지 않습니다. 음란물 검열한다고 시작해서 그 방식을 사회 문제 검열, 정치 탄압으로 확대하는 방식을 쓰죠. 우리나라 과거에 그랬고 중국이나 여타 독재 국가에서 흔하게 볼 수 있는 케이스이죠. 시진핑이 저 기술을 약간 비틀어서 팀 쿡에게 시진핑 풍자 사진 검열하라고 시키지 않는다는 보장이 없죠

루리웹-6942285846

아무말 대잔치

취지 자체는 좋은데 기업들이란게 조금이라도 여지를 주면 그걸로 아주 별짓을 다해먹는게 당연해서....

아동 어쩌고 관련해선 엄근진 겁나게 따지고 합리화하는 영미권에서도 파토날 정도면 거기서도 어지간히 미친 짓으로 보였나 봅니다.